Video koji navodno prikazuje napade na Tel Aviv generiran je umjetnom inteligencijom

- Objavljeno 12. ožujka 2026. u 13:14

- Minuta potrebno za čitanje: 5

- Autor: Pierre MOUTOT, AFP Francuska

- Prijevod i prilagodba Gabriela LULIC, AFP Hrvatska

Masovni američko-izraelski zračni napadi na Iran krajem veljače 2026. pokrenuli su rat na Bliskom istoku, nakon čega je Iran uzvratio napadima raketama i dronovima na Izrael te na američke baze u regiji. U tom kontekstu društvenim mrežama proširio se viralni video koji navodno prikazuje niz raketnih napada na izraelski grad Tel Aviv i prikupio je milijune pregleda. No snimka je zapravo generirana uz pomoć umjetne inteligencije i ne postoji nikakav dokaz da se događaj koji prikazuje doista dogodio.

"Veliki napad Irana na Tel Aviv 3.3.2026… Video potvrđen da je pravi," piše u opisu objave na Facebooku od 3. ožujka 2026. godine. Ispod opisa podijeljen je video koji prikazuje raketiranje grada, a na njemu se nalazi naslov "Veliko raketiranje Tel Aviva 3. 3. 2036.".

Isti video uz slične tvrdnje podijeljen je i među mnogim medijima na bosanskom, srpskom i crnogorskom jeziku.

Osim medija u regionu, video je podijeljen s istim tvrdnjama i na mnogim drugim jezicima, uključujući arapski, engleski, francuski i njemački, te je prikupio stotine tisuća lajkova i dijeljenja.

No u stvarnosti video pokazuje karakteristične znakove da je stvoren s pomoću umjetne inteligencije, a napadi koji se u njemu vide ne odgovaraju nijednom događaju koji je dosad zabilježen.

Znakovi tipični za video generiran umjetnom inteligencijom

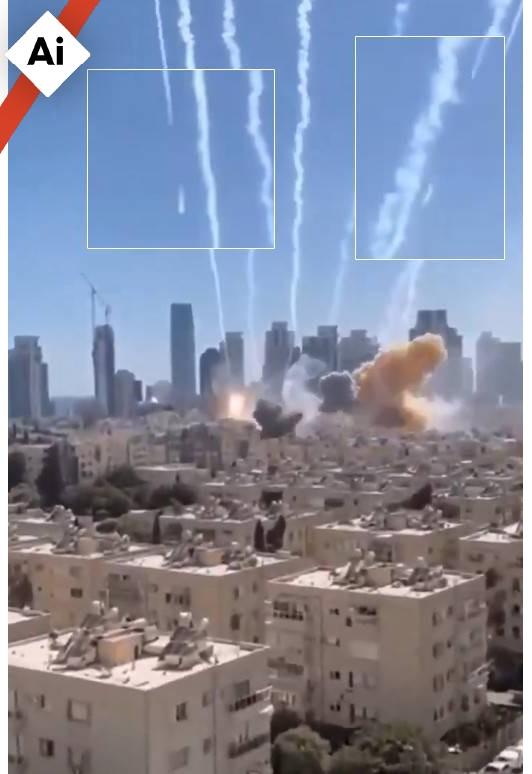

Prije svega, video sadrži nekoliko vizualnih nedosljednosti koje su tipične za sadržaj generiran umjetnom inteligencijom.

Snimka je montirana tako da izgleda kao da je snimljena pametnim telefonom, s početnim zumiranjem prema području koje pogađaju projektili. Tijekom zumiranja i udaljavanja slike automobili poprimaju neobične oblike. Neki izgledaju kao da su spojeni jedan s drugim, dok su drugi djelomično nedovršeni ili čudno iskrivljeni.

Na krovovima zgrada u pozadini, među solarnim panelima koji na neobično ujednačen način prekrivaju svaki krov, također se mogu primijetiti izobličenja i vizualne nepravilnosti.

Tragovi dima iza projektila na nekim mjestima naglo se prekidaju.

Na kraju videa, dvije građevinske dizalice pojavljuju se tek u trenutku kada kamera zumira prema području udara.

AFP je objavio nekoliko vodiča kao na primjer ovdje i ovdje, kako bi pomogao javnosti u prepoznavanju izmijenjenog sadržaja.

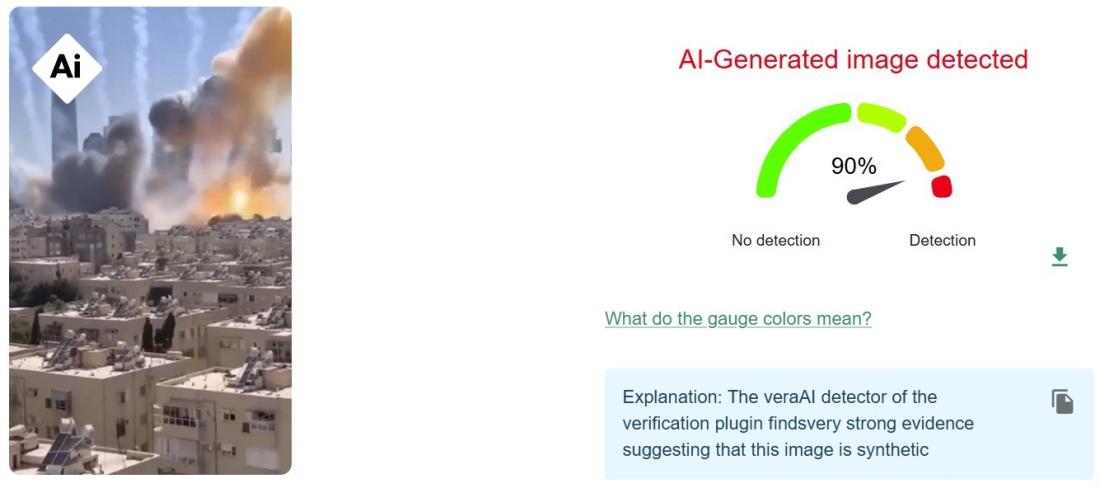

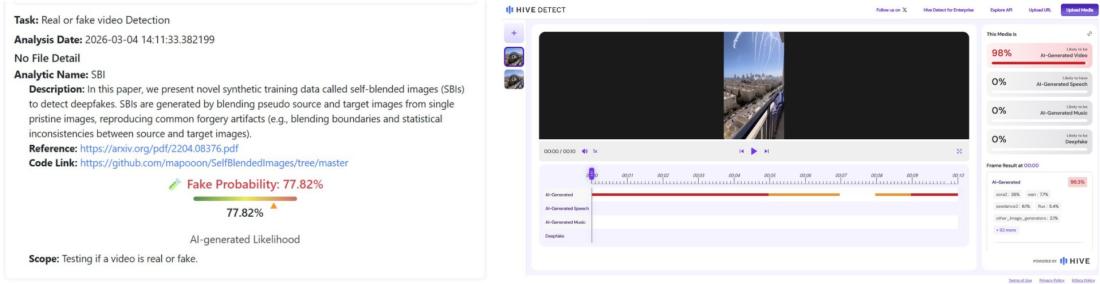

Dodatne analize provedene s pomoću alata za otkrivanje izmijenjenog sadržaja dale su visoke rezultate koji upućuju na to da je video vjerojatno generiran s pomoću alata za stvaranje sadržaja temeljenih na umjetnoj inteligenciji. Provjere provedene na pojedinim kadrovima iz videa s pomoću verifikacijskog alata InVid-WeVerify, koji je razvijen u suradnji s AFP-om, pokazale su da postoji velika vjerojatnost da su slike stvorene uz pomoć umjetne inteligencije.

Testovi provedeni s pomoću modela DeepFake-O-Meter za otkrivanje sintetičkih generiranih slika, koji je razvio Media Forensics Lab na Sveučilištu u Buffalu, kao i analiza videa na platformi Hive Moderation, također su pokazali da postoji velika vjerojatnost da je video generiran uz pomoć umjetne inteligencije.

Osim toga, niz drugih tragova upućuje na to da video nije autentičan.

Video ne odgovara stvarnim događanjima

Obrnuta pretraga slike i napredno pretraživanje interneta pokazali su da nijedan izraelski lokalni ili nacionalni medij nije izvijestio o takvim snimkama, kao što su to činili u slučaju drugih raketnih napada na grad u danima nakon početka rata. AFP-ovi dopisnici na terenu također nisu svjedočili ovom navodnom napadu.

Na internetu ni na društvenim mrežama nije moguće pronaći nijednu drugu snimku koja prikazuje taj incident, unatoč njegovoj upečatljivoj prirodi zbog 15 dimnih tragova koje su navodno ostavile lansirane rakete.

Na snimci se također ne čuje zvuk sirena za zračnu uzbunu, za razliku od snimaka drugih napada koji su pogodili Izrael.

Tel Aviv je doista bio meta nekoliko raketnih napada, koje su izveli Iran i njegov saveznik, libanonska šiitska stranka Hezbolah. Međutim, istragom AFP-a nije pronađen nikakav trag napada takvih razmjera u središtu izraelskog grada, koji bi zasigurno prouzročio velik broj poginulih i ozlijeđenih.

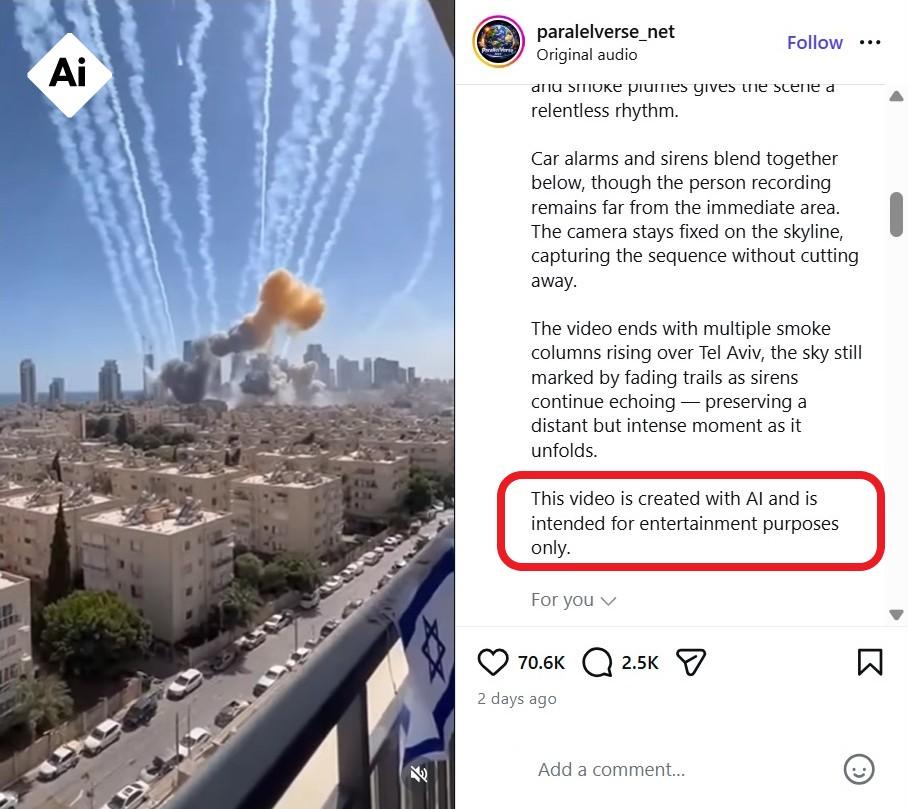

Obrnuta pretraga slike također je dovela do najranije verzije snimke koju je AFP uspio pronaći, objavljene 2. ožujka 2026. na jednom Instagram profilu koji, čini se, dijeli i druge videozapise generirane umjetnom inteligencijom.

Objava sadrži napomenu da je video "stvoren uz pomoć umjetne inteligencije i namijenjen isključivo u zabavne svrhe". Opis uz objavu donosi detaljan izmišljeni scenarij raketnih napada na Tel Aviv, što upućuje na to da je snimka zamišljena kao sintetički sadržaj, a ne kao dokumentacija stvarnog događaja. Čini se da je opis napisan kao "prompt", odnosno tekstualna uputa koju korisnik daje AI generatoru kako bi stvorio fotografiju ili video sadržaj.

AI chatbotovi proširili su netočne informacije

Širenje videa dodatno su potaknuli netočni odgovori na upite korisnika na pojedinim platformama, u kojima se tvrdilo da je snimka autentična i provjerena. Kada su ga korisnici pitali o vjerodostojnosti videa, X-ov AI chatbot Grok više je puta odgovorio da je "video stvaran".

Ovo nije prvi put da je chatbot pogriješio. To se već događalo, osobito u vezi s drugim osjetljivim temama, poput sukoba između Indije i Pakistana ili protuimigracijskih prosvjeda u Sjedinjenim Američkim Državama.

Borbe između Izraela i Irana nastavljene su intenzivnim zračnim napadima Sjedinjenih Država i Izraela na iranske ciljeve (arhivirano je ovdje). Sukob se već ranije proširio na širu regiju, a iranske rakete i dronovi pogodili su nekoliko zemalja 28. veljače, a posljednjih dana traju i razmjene napada između Izraela i Hezbollaha preko libanonske granice. Rano ujutro 12. ožujka Hezbolah je rekao da je lansirao rakete na izraelsku vojno-obavještajnu bazu u predgrađu Tel Aviva.

Ovaj regionalni rat već je potaknuo veliku količinu dezinformacija. AFP je već ranije razotkrio i druge dezinformacije o sukobu na Bliskom istoku.

Copyright © AFP 2017-2026. Za bilo kakvu komercijalnu uporabu ovog sadržaja potrebna je pretplata. Kliknite ovdje za više informacija.

Vidjeli ste sumnjivu informaciju na društvenim mrežama?

Kontaktirajte nas